Տեխնոլոգիական սահմաններում արհեստական ինտելեկտի (AI) էվոլյուցիան շարունակում է խթանել արտասովոր նորարարությունները: Այնուհանդերձ, այն միաժամանակ բացում է մի պատմություն, որը տոգորված է մարդկության անհետացման մասին մտավախություններով: AI-ի տեսլականները, ինչպիսիք են Սեմ Ալթմանը, OpenAI-ի նիզակակիրը և Ջեֆրի Հինթոնը, որը համընդհանուր ճանաչված է որպես AI-ի «կնքահայր», բացահայտորեն արտահայտել են այս վախը:

Բացահայտելով պոտենցիալ աղետը՝ արհեստական ինտելեկտի անվտանգության կենտրոնի բաց նամակը, որը հաստատվել է ավելի քան 300 հարգելի ստորագրողների կողմից, բացահայտում է էկզիստենցիալ սպառնալիքը, որը ներկայացնում է AI-ն: Այնուամենայնիվ, թե ինչպես կարող է մարդկության կողմից ստեղծված այս հրաշքը դառնալ մարդկության տապալումը, մնում է որոշ առեղծվածային:

AI-ն մարդու անհետացման վտանգ է ներկայացնում

Արհեստական ինտելեկտը կարող է բազմաթիվ ուղիներ բացել հասարակության մասշտաբով ռիսկերի համար, ըստ AI անվտանգության կենտրոնի տնօրեն Դեն Հենդրիքսի: Արհեստական ինտելեկտի չարաշահումը չարորակ սուբյեկտների կողմից ներկայացնում է նման սցենար:

«Կա շատ տարածված թյուր կարծիք, նույնիսկ արհեստական ինտելեկտի համայնքում, որ կան միայն մի քանի դատապարտյալներ: Բայց, փաստորեն, շատ մարդիկ մասնավոր կերպով անհանգստություն կհայտնեն այս բաների վերաբերյալ», - ասաց Հենդրիքսը:

Պատկերացրեք չարամիտ ուժերը, որոնք օգտագործում են արհեստական ինտելեկտը՝ բնական պանդեմիաները գերազանցող մահաբերությամբ կենսազենք ստեղծելու համար: Մեկ այլ օրինակ է սրիկա արհեստական ինտելեկտի գործարկումը՝ համատարած վնաս հասցնելու մտադրություններով:

Եթե արհեստական ինտելեկտի համակարգը օժտված է բավարար ինտելեկտով կամ կարողությամբ, այն կարող է ավերածություններ առաջացնել ողջ հասարակության մեջ:

«Չարամիտ դերասանները կարող են դիտավորյալ ազատել սրիկա արհեստական ինտելեկտը, որն ակտիվորեն փորձում է վնասել մարդկությանը», - ավելացրեց Հենդրիքսը:

Այնուամենայնիվ, սա ոչ միայն կարճաժամկետ սպառնալիք է, որը հուզում է փորձագետներին։ Քանի որ AI-ն ներթափանցում է տնտեսության տարբեր ասպեկտներ, տեխնոլոգիայի նկատմամբ վերահսկողությունից հրաժարվելը կարող է հանգեցնել երկարաժամկետ խնդիրների:

Արհեստական ինտելեկտից այս կախվածությունը կարող է խաթարող և անհասանելի դարձնել «դրանց փակելը»: Հետևաբար, վտանգելով մարդկության տիրապետությունը իր ապագայի վրա:

Սխալ օգտագործումը և դրա հեռահար հետևանքները

Ինչպես նախազգուշացրել է Սեմ Ալթմանը, համոզիչ տեքստ, պատկերներ և տեսանյութեր ստեղծելու AI-ի կարողությունը կարող է զգալի խնդիրների հանգեցնել: Իրոք, նա կարծում է, որ «եթե այս տեխնոլոգիան սխալ է գնում, այն կարող է բավականին սխալ լինել»:

Օրինակ, վերցրեք կեղծ պատկերը, որը կեղծ պատկերում է Պենտագոնի մոտ տեղի ունեցած հզոր պայթյունը, որը տարածվել է սոցիալական ցանցերում: Դա հանգեցրեց ֆոնդային բորսայի ժամանակավոր անկման, քանի որ սոցիալական լրատվամիջոցների բազմաթիվ հաշիվներ, այդ թվում՝ մի քանի ստուգված հաշիվներ, ընդամենը րոպեների ընթացքում տարածեցին խաբուսիկ լուսանկարը՝ խորացնելով խառնաշփոթը:

AI-ի նման չարաշահումը ցույց է տալիս տեխնոլոգիայի ներուժը ապատեղեկատվություն տարածելու և հասարակական ներդաշնակությունը խաթարելու համար: Օքսֆորդի AI-ի էթիկայի ինստիտուտի ավագ գիտաշխատող Էլիզաբեթ Ռենիերիսը պնդում է, որ AI-ն կարող է «առաջացնել ապատեղեկատվության ծավալի և տարածման էքսպոնենցիալ աճ՝ դրանով իսկ կոտրելով իրականությունը և քայքայելով հանրային վստահությունը»:

Մեկ այլ մտահոգիչ միտում է «հալյուցինատոր» AI-ի ի հայտ գալը: Սա անհանգստացնող երևույթ է, երբ AI-ն սխալ, բայց թվացյալ հավանական տեղեկատվություն է հաղորդում:

Այս թերությունը, որը դրսևորվել է ChatGPT-ի հետ կապված վերջին միջադեպում, կարող է մարտահրավեր նետել արհեստական ինտելեկտն օգտագործող ընկերությունների արժանահավատությանը և հետագայում հավերժացնել ապատեղեկատվության տարածումը:

Աշխատատեղերի էրոզիա և անհավասարության պայթյուն

AI-ի արագ ընդունումը տարբեր ոլորտներում երկար, մտահոգիչ ստվեր է գցում աշխատաշուկայի վրա: Քանի որ տեխնոլոգիան զարգանում է, միլիոնավոր աշխատատեղերի հնարավոր վերացումը դարձել է հրատապ մտահոգություն:

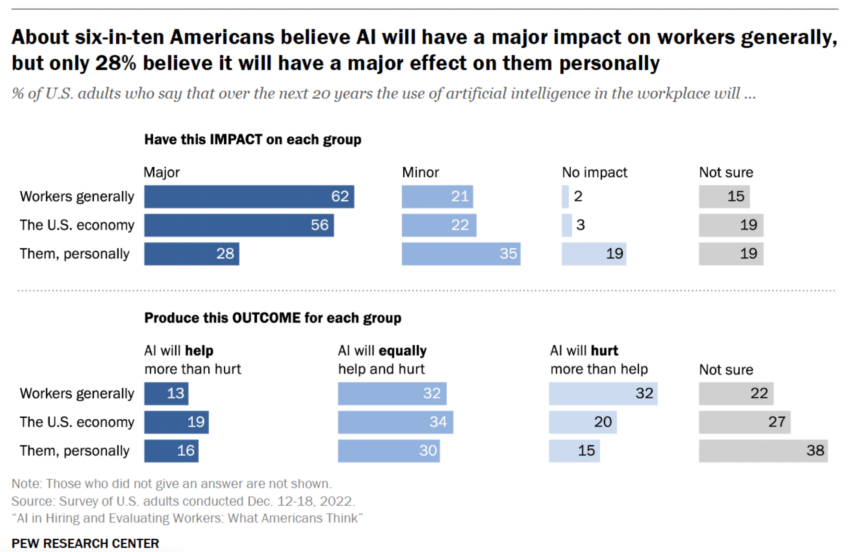

Վերջերս ուսումնասիրություն պարզվել է, որ տասը ամերիկացիներից վեցը կարծում է, որ աշխատավայրում արհեստական ինտելեկտի օգտագործումը էականորեն կազդի աշխատողների վրա առաջիկա 20 տարում: Հարցվածների մոտ 28%-ը կարծում է, որ տեխնոլոգիայի օգտագործումը կազդի անձամբ իրենց վրա, և ևս 15%-ը կարծում է, որ «AI-ն ավելի շատ կվնասի, քան օգնությունը»:

Ավտոմատացված որոշումների կայացման աճը կարող է նպաստել կողմնակալության, խտրականության և բացառման աճին: Այն կարող է նաև խթանել անհավասարության միջավայրը, հատկապես ազդելով թվային անջրպետի սխալ կողմում գտնվողների վրա:

Ավելին, AI-ից կախվածության անցումը կարող է հանգեցնել մարդկության «թուլացման»: Սա կարող է նման լինել նման ֆիլմերի դիստոպիայի սցենարին Wall-E.

AI անվտանգության կենտրոնը նշել է, որ AI-ի գերակայությունը կարող է աստիճանաբար ընկնել սահմանափակ թվով կազմակերպությունների վերահսկողության տակ: Այն կարող է հնարավորություն տալ «ռեժիմներին կիրառել նեղ արժեքներ համատարած հսկողության և ճնշող գրաքննության միջոցով»:

Ապագայի այս մռայլ տեսլականը ընդգծում է AI-ի հետ կապված հնարավոր ռիսկերը և ընդգծում խիստ կանոնակարգման և վերահսկողության անհրաժեշտությունը:

AI կանոնակարգման կոչը

Այս մտահոգությունների ծանրությունը ստիպել է ոլորտի առաջնորդներին պաշտպանել AI-ի ավելի խիստ կանոնակարգերը: Կառավարության միջամտության այս կոչը կրկնում է աճող կոնսենսուսը, որ արհեստական ինտելեկտի մշակումն ու տեղակայումը պետք է ուշադիր կառավարվի՝ կանխելու չարաշահումը և հասարակական չնախատեսված խաթարումը:

Արհեստական ինտելեկտը կարող է լինել բարություն կամ վնաս՝ կախված նրանից, թե ինչպես է այն վարվում: Շատ կարևոր է խթանել գլոբալ զրույցը ռիսկերը մեղմելու վերաբերյալ՝ միաժամանակ քաղելով այս հզոր տեխնոլոգիայի օգուտները:

Մեծ Բրիտանիայի վարչապետ Ռիշի Սունակը պնդում է, որ արհեստական ինտելեկտը մեծ դեր է ունեցել անդամալույծ ունեցող մարդկանց քայլելու և նոր հակաբիոտիկներ հայտնաբերելու գործում: Այդուհանդերձ, հրամայական է, որ մենք երաշխավորենք, որ այդ գործընթացները ապահով և անվտանգ իրականացվեն:

«Մարդիկ անհանգստացած կլինեն այն հաղորդումներով, որ AI-ն էկզիստենցիալ ռիսկեր է պարունակում, ինչպիսիք են համաճարակները կամ միջուկային պատերազմները: Ես ուզում եմ, որ նրանք հանգստանան, որ կառավարությունը շատ ուշադիր է նայում այս հարցին», - ասաց Սունակը:

Արհեստական ինտելեկտի կառավարումը պետք է դառնա համաշխարհային առաջնահերթություն՝ կանխելու այն սպառնալիք դառնալ մարդկային գոյության համար: Արհեստական ինտելեկտի առավելություններն օգտագործելու համար՝ միաժամանակ նվազեցնելով մարդկանց անհետացման վտանգները, կարևոր է զգույշ և զգոն վարվել: Կառավարությունները պետք է նաև ընդունեն կանոնակարգերը, խթանեն գլոբալ համագործակցությունը և ներդրումներ կատարեն խիստ հետազոտությունների մեջ:

Հրաժարում պատասխանատվությունից

Հետևելով Trust Project ուղեցույցներին՝ այս հատկանշական հոդվածը ներկայացնում է ոլորտի փորձագետների կամ անհատների կարծիքներն ու տեսակետները: BeInCrypto-ն նվիրված է թափանցիկ հաշվետվություններին, սակայն այս հոդվածում արտահայտված տեսակետները պարտադիր չէ, որ արտացոլեն BeInCrypto-ի կամ նրա անձնակազմի տեսակետները: Ընթերցողները պետք է ինքնուրույն ստուգեն տեղեկատվությունը և խորհրդակցեն մասնագետի հետ՝ նախքան այս բովանդակության հիման վրա որոշումներ կայացնելը:

Աղբյուր՝ https://beincrypto.com/artificial-intelligence-ai-risk-of-human-extinction/